오전에는 특강 오후에는 팀플이 있었다.

4강. Regression

Linear regression

쌍으로 관찰된 연속형 변수들 사이의 관계에 대해서

한 변수를 원인으로 하고 다른 변수들을 결과로 하는 분석

독립변수에 따라 종속변수로 선형으로 예측한다.

mse를 최소로하는 값을 구해야 한다. 미분값이 0이 되는 값을 찾는다.

높은 차수의 모델을 선택하는 것은 좋은가?

오버피팅을 조심하라. 너무 잘 표현하려고 하면 과대적합이 일어나 일반적인 모델에서 성능이 떨어질 수 있다.

데이터에 대해 적절한 회귀 모델을 찾으려고 한다.

해결법 ) 규제를 둔다. regularzation

Gradient descent

손실함수를 최소화하는 방법으로 최적값을 찾아야 한다.

1. w를 어느 방향으로 바꿔줘야 하냐?

-> 미분을 했을 때 기울기의 반대 방향, 편미분 값 * - 1

2. 얼마나 가야 하느냐?

-> 학습률을 정의해야 한다. 얼마나 갈 지 정해지지 않았다.

- 초반에는 높게 잡고, 나중에는 작게 잡거나

- 가속도를 고려한 학습률을 지정하거나

- 값의 변화의 차이를 고려해주거나

Batch GD vs Mini-batch GD vs SGD

산에서 내려오는데 방향을 모른다. 그때 길을 찾을 때...

1. 헬기에서 본 것처럼 제일 빠른 길을 찾는다.

2. 1 + 3을 합친 것이다. 가장 많이 쓴다.

3. 지금 있는 데서 가장 낮은 방향을 보고 가는 것이다.

SGD는 계산량을 확 줄이면서 가장 낮은 방향을 본다.

5강. Classification & Clustering

연속적인 값이 아니라 0 아니면 1이다.

불연속적인 값을 가지는 문제다.

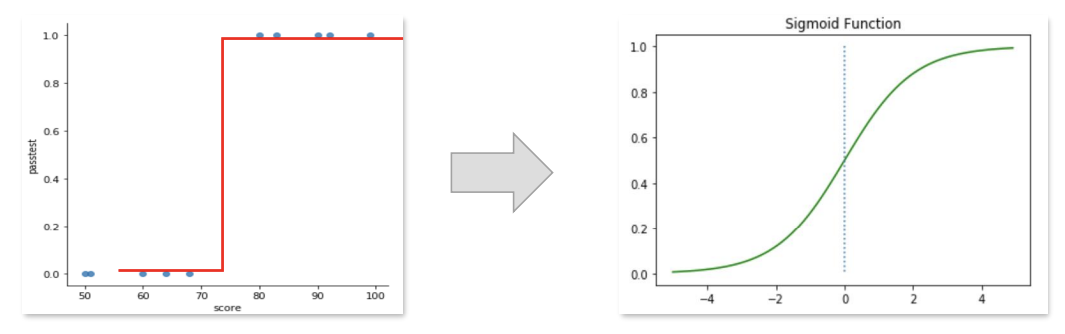

계단함수와 같은 함수로 regression => classification

이진 분류 - sigmoid function

여러 개 분류 - softmax function

* loss function : Cross entropy

mse가 적당하지 않다.

softmax는 k 개를 예측해야 한다.

기계학습을 정리한 것 같아서 알찬 강의였다.

'2023 활동 - 4학년 > [1월 ~ 4월] sw 아카데미 백엔드 과정' 카테고리의 다른 글

| [2023.01.06 / CNU SW 아카데미] 한 주가 끝났다. (0) | 2023.01.06 |

|---|---|

| [2023.01.05 / CNU SW 아카데미] 팀프로젝트 시작 (0) | 2023.01.05 |

| [2023.01.04 / CNU SW 아카데미] 백엔드 미니 데브코스 (2) | 2023.01.04 |

| [2023.01.04 / CNU SW 아카데미] 특강.데이터분석 및 AI 기초2 (0) | 2023.01.04 |

| [2023.01.03 / CNU SW 아카데미] 특강.데이터분석 및 AI 기초1 (0) | 2023.01.03 |